Mi a Google-index és mire jó?

Frissítve: Pál Zoltán Gábor

Te is tudod, hogy van ez: a nagy titkokról mindenki szeretne tudni, de megérteni azokat már nem olyan egyszerű feladat! Valahogy így van ez a Google-index kapcsán is; megannyi kérdés felmerül: mire jó, hogyan működik, és miért olyan fontos?

A címben feltett kérdés már csak azért is releváns, mert a keresőóriás sikerét az a zseniális, de rendkívül bonyolult rendszer hozta meg, amit az elmúlt évtizedekben aprólékos munkával felépítettek.

Ez a cikk ezért bemutatja, hogyan térképezi fel a Google az internetet, és hogy milyen munka zajlik a keresi találatok mögött.

Robotok és megabájtok

Csak saccolni tudunk, mert pontos számokat lehetetlen mondani, de az indexált világháló több tízmilliárd weboldalt tartalmaz; volt már ez a szám idén 60 milliárd felett is, de az arany közép valahol 55-57 között található. Vannak olyan honlapok, amelyek időközben eltűnnek; és vannak persze újak is; egyesek pedig nem kérik a „felvételüket” ebbe a rendszerbe (lásd robots.txt).

A Google által indexált (kvázi ismert) honlapok száma 2019 május végén nagyjából ugyanennyi (itt is folyamatos a változás, február-március környékén például 54 milliárd alá csökkent), miközben a Bing esetében 1,5-1,6 milliárdról beszélünk. A Yahoo pedig már nem is közli az ezzel kapcsolatos adatokat.

Kisstílű, de igaz: még a vak is látja, hogy a Google (és algoritmusa, a PageRank) minek köszönheti a sikerét. A keresőóriás robotjai weboldalak milliárdjairól képesek információt gyűjteni, majd azokat megfelelően rendszerezni a saját keresési indexükben. A keresőmotorok minőségének legfontosabb faktora pedig ennek az indexnek a mérete, hiszen ez határozza meg, hogy egy adott kulcsszóra vagy kifejezésre milyen honlapok és milyen sorrendben jelennek meg a találati listában.

Vagy hogy megjelennek-e egyáltalán, lévén egy nem indexált weboldalt hiába keres a felhasználó, találatként az nem fog megjelenni. Ennek az az oka, hogy a keresőmotorok nem valósidőben dolgoznak, hanem a robotok által összegyűjtött és az indexbe rendszerezett adatok alapján. Csak azokról a weblapokról tudnak, amelyekről előtte tudomást szereztek.

Az internet Kolumbusz Kristófja

A keresőrobotok a régi felfedezőkhöz hasonló munkát végeznek a világháló tengerén: már ismert vagy még ismeretlen weblapokat fedeznek fel újra és újra. Mindennapos munkájuk során a robotok pontosan feltérképezik a webhelyeket (leginkább a linkek segítségével), és az összegyűjtött információ(ka)t elhelyezik az indexben.

Ez tárgymutatóként funkcionál a Google rendszerében, vagyis a felhasználói keresés során a keresőmotor a saját webes indexében keresi meg és gyűjti ki az általa legjobbnak tartott válaszokat. Az utolsó mondatrész a keresőoptimalizálás alapja, hiszen minden weblaptulajdonos szeretné a lehető legjobb helyezést elérni. Ez viszont csak akkor lehetséges, ha az általa készített weblapot könnyedén fel tudják térképezni és megfelelően el tudják helyezni az indexben a robotok.

Erre szokták azt mondani a szakértők, hogy egy weboldal legyen keresőbarát: explicite nem a külcsínre vagy a tartalom minőségére utalnak, hanem arra, hogy az megkönnyíti-e az algoritmus és a robotok munkáját.

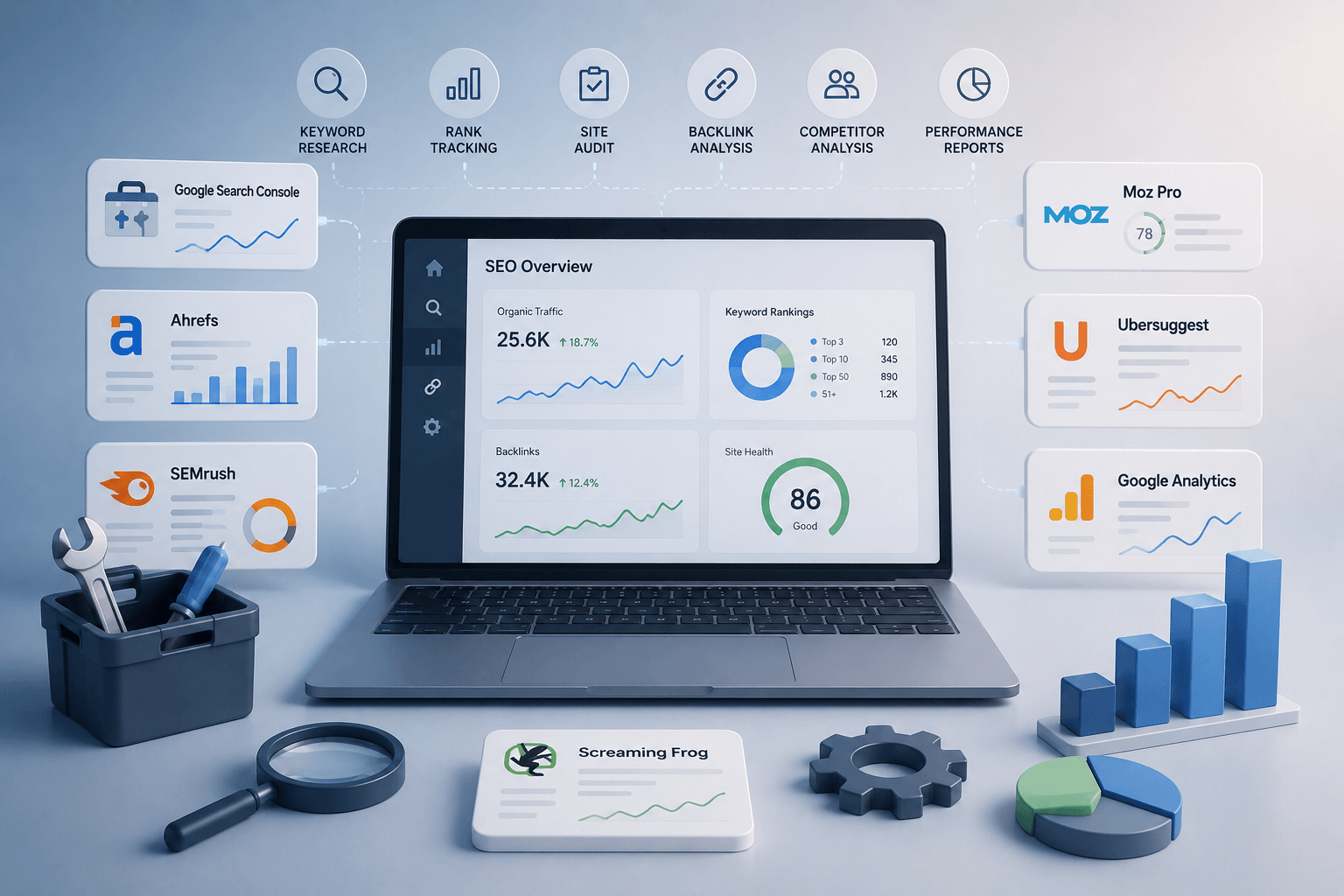

Gyakori tévedés azt hinni, hogy ez a feladat kimerül a kulcsszavak halmozásában, de a keresőrobotok nem úgy gondolkodnak, mint egy ember, és nem is úgy olvassák a weboldalakat, mint mi. Rengeteg rangsorolási faktor van, amire ügyelni kell egy honlap elkészítésekor; a Google esetében például 200-at is össze lehet gyűjteni (ehhez lásd a Backlinko listáját).

Ide tartoznak (sok más mellett):

- a domain (életkor, múlt, benne található kulcsszó)

- URL hossza

- a tagekben szereplő kulcsszavak (title tag, description tag, H1 tag)

- kulcsszó-sűrűség (csak egy a kétszázból)

- kép(méret) optimalizálása

- a tartalom frissítésének gyakorisága

- a tartalom minősége

- kifelé mutató linkek száma, minősége

- a honlap felépítése

Hogyan képzeld el a Google-indexet?

Nem kell feltalálnunk a spanyolviaszt, hiszen ez a hasonlat is viszonylag ismert: az egészet valahogy úgy kell elképzelni, mint egy könyvtárat, amely tele van izgalmas, változatos könyvekkel. Sok millió szerző műveivel, amelyek a legkülönbözőbb műfajban és stílusban íródtak.

De bármilyen pompásan is hat e sok könyv látványa, abba még belegondolni is ijesztő, hogy segítség nélkül miképp keresné ki az ember azokból a neki fontos válaszokat. Aki járt már könyvtárban, az pontosan tudja, hogy mivel könnyítik meg ilyenkor a kölcsönözni akarók dolgát: egy precíz katalógussal, ami cím, szerző és egyéb fontos információk alapján teszi kereshetővé a könyveket.

A mi esetünkben a katalógus szerepét a Google-index tölti be, és a könyvtáros maga a robot, aki feltérképezett minden könyvet, és az azokkal kapcsolatos információkat – még jóval a felhasználói keresés előtt – el is helyezte a katalógusban. De nemcsak a címeket és a szerzők nevét, hanem a könyvek tartalmát is: a robotkönyvtáros mondatról mondatra digitalizálta az egészet, így megfelelő keresési kifejezésre megfelelő választ kaphat mindenki.

A katalógus nemcsak azt tudja, hogy az egy egyes könyvek hol találhatók, hanem azt is, hogy mi van bennük, és azonnal oda is navigál a megfelelő könyvhöz…

… oldaladhoz.

Mindezt a pillanat törtrésze alatt. Anélkül, hogy a könyvtárosnak minden kereséskor újra és újra végig kellene nyálaznia az összes könyvet. A katalógus ezt a munkát helyettesíti, és ezért érhető el a találati lista (a kérdésekre adott válasz) ilyen gyorsan.

Valószínűleg te is rájöttél arra, hogy ebben a hasonlatban a könyvtár maga az internet…

… a feltérképezésről nem egy, nem kettő, hanem sok-sok robot gondoskodik…

… és a polcokon több milliárd könyv áll; sok épp most került fel, más épp most került le. A könyvtár folyamatosan bővül, és a te weboldalad csak egyik tagja annak.

A robotkönyvtárosok dolgát és az elvárt rangsorolást úgy tudod megkönnyíteni, ha a Google-indexébe a megfelelő módon kerülsz be. Ezt pedig csak professzionális keresőoptimalizálással biztosíthatod.